Pubblicato il: 26 Novembre 2025 alle 10:15

Indice dei contenuti

- Introduzione

- Il mito dell’anonimizzazione leggera: perché oscurare i dati personali non basta

- I tre livelli della conformità: dall’illusione di sicurezza alla reale compliance

- Le zone d’ombra che nessuno spiega agli orientatori: casi reali di non conformità invisibile

- Strategie operative per orientatori: come sfruttare l’IA rimanendo nella legalità

- Cosa succede quando si sbaglia: conseguenze reali della non conformità

- Conclusione

Introduzione

L’orientatore che cancella nome e cognome da un curriculum prima di caricarlo su ChatGPT pensa di essere in regola con il GDPR. Non lo è. Il consulente di carriera che usa il proprio account personale Pro di Claude per migliorare le lettere motivazionali dei clienti crede di agire professionalmente. Sta violando la normativa europea sulla privacy. Il responsabile di un centro per l’impiego che chiede all’intelligenza artificiale di analizzare profili professionali “oscurando i dati sensibili” è convinto di tutelare gli utenti. In realtà sta esponendo l’ente a sanzioni potenzialmente devastanti.

Esiste un abisso tra ciò che gli orientatori credono sia sufficiente per rispettare la privacy nell’uso dell’IA e ciò che il GDPR effettivamente richiede. E questo gap non è solo una questione burocratica: è un rischio professionale, legale e reputazionale che la maggior parte degli operatori sottovaluta drammaticamente.

La verità scomoda è che l’integrazione dell’intelligenza artificiale nelle attività di orientamento ha creato una zona grigia normativa che molti professionisti navigano con una pericolosa combinazione di ignoranza delle regole e ottimismo procedurale. Questo articolo fornisce agli orientatori una mappa operativa chiara per distinguere ciò che è lecito da ciò che costituisce violazione, offrendo soluzioni concrete per sfruttare le potenzialità dell’IA rimanendo nella piena legalità.

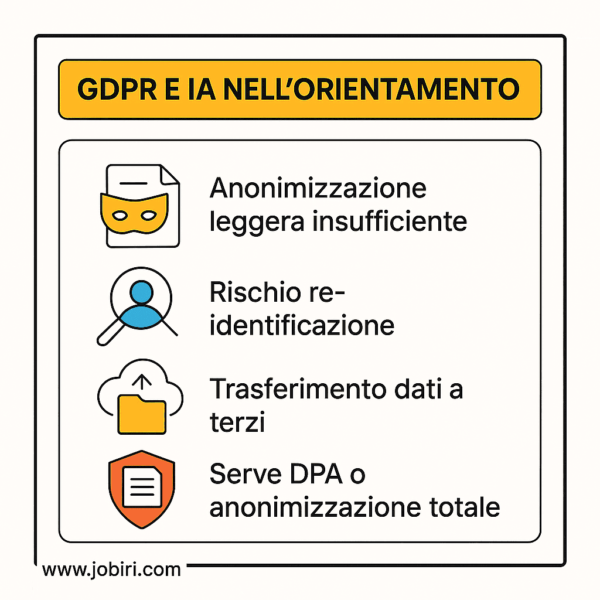

Il mito dell’anonimizzazione leggera: perché oscurare i dati personali non basta

Molti orientatori operano con una convinzione rassicurante ma errata: se rimuovono nome, cognome, indirizzo e numero di telefono da un documento prima di caricarlo su una piattaforma di intelligenza artificiale, hanno adempiuto agli obblighi di privacy. Questa pratica, definita tecnicamente “anonimizzazione leggera”, è diventata lo standard de facto in migliaia di studi professionali, centri di orientamento e agenzie formative. Ma esiste un problema fondamentale: dal punto di vista del GDPR, questa procedura non garantisce affatto l’anonimato e, soprattutto, non risolve la questione principale del trattamento dei dati personali.

La ricerca sulla re-identificazione dei dati dimostra un fatto inquietante: anche dataset apparentemente anonimi possono essere ricondotti a persone specifiche incrociando poche informazioni con fonti pubbliche o semi-pubbliche. Un curriculum che contiene “laureato in Ingegneria Gestionale al Politecnico di Milano nel 2018, ha lavorato tre anni in Luxottica come project manager, poi due anni in una startup milanese del settore fintech” permette, con alta probabilità, di identificare la persona anche senza nome e cognome. Basta accedere a LinkedIn, incrociare le informazioni e l’anonimato svanisce.

Ma c’è un aspetto ancora più critico che sfugge alla maggior parte degli orientatori: il GDPR non guarda solo al risultato finale (il dato è anonimo o no?), ma al processo di trattamento. Quando un orientatore carica un documento contenente informazioni professionali, formative e personali di un utente su una piattaforma di IA, sta trasferendo dati personali a un soggetto terzo. E questo trasferimento richiede una base giuridica specifica, garanzie contrattuali precise e, nella maggior parte dei casi, un Data Processing Agreement (DPA) che la stragrande maggioranza degli account personali di servizi IA non prevede.

La conseguenza? Un orientatore che utilizza ChatGPT Pro, Claude Pro o Copilot con account personale per elaborare materiali contenenti dati di utenti – anche se parzialmente oscurati – sta operando in violazione del Regolamento Europeo 679/2016, esponendosi a sanzioni che possono arrivare fino al 4% del fatturato annuo o 20 milioni di euro, oltre alle conseguenze reputazionali devastanti per la propria attività professionale.

I tre livelli della conformità: dall’illusione di sicurezza alla reale compliance

Esiste una gerarchia di conformità che molti orientatori non conoscono o sottovalutano. Il primo livello – quello in cui opera la maggioranza dei professionisti – è quello dell’illusione procedurale: “Ho cancellato i dati sensibili, quindi sono a posto”. Come già evidenziato, questo approccio non garantisce né anonimato reale né conformità normativa. Si tratta di una falsa sicurezza che dura fino al primo controllo del Garante della Privacy o fino alla prima contestazione di un utente che scopre come sono stati trattati i suoi dati.

Il secondo livello è quello della consapevolezza parziale: l’orientatore comprende che servono misure più robuste e adotta quello che tecnicamente viene definito “pseudonimizzazione”, sostituendo dati identificativi con codici reversibili. Per esempio, trasforma “Mario Rossi, laureato alla Bocconi” in “Candidato_001, laureato presso Università_A”. Questa pratica rappresenta un passo avanti, ma resta problematica per un motivo fondamentale: se esiste da qualche parte una tabella di corrispondenza che permette di ricollegare Candidato_001 a Mario Rossi, il GDPR considera quei dati ancora “personali” e quindi soggetti a tutte le tutele previste dalla normativa. La pseudonimizzazione non elimina gli obblighi, li attenua solo parzialmente.

Il terzo livello è quello della conformità reale, e si articola su due direttrici alternative. La prima direttrice richiede l’uso di account business delle piattaforme IA che includono un Data Processing Agreement conforme al GDPR. Servizi come ChatGPT Team o Enterprise, Microsoft 365 Copilot for Business, o Google Workspace con Gemini includono garanzie contrattuali che nominano il fornitore come “responsabile del trattamento”, stabiliscono dove vengono conservati i dati, impediscono che vengano utilizzati per addestrare i modelli, e definiscono chiaramente responsabilità e limitazioni. Con questi strumenti, l’orientatore può trattare dati personali degli utenti – entro limiti precisi e con consenso informato – rimanendo nella legalità.

La seconda direttrice della conformità reale è l’anonimizzazione totale e irreversibile: sostituire ogni elemento identificativo con codici generici utilizzando modelli di IA che operano in locale sul computer dell’orientatore, senza connessione cloud. Strumenti come GPT4All, Ollama o PrivateGPT permettono di processare documenti senza che alcun dato lasci il dispositivo del professionista. Solo dopo questa anonimizzazione completa il testo può essere caricato su piattaforme cloud per elaborazioni più sofisticate, per poi essere “ripristinato” nuovamente in locale. Un processo complesso, certosino, ma l’unico che garantisce protezione assoluta quando non si dispone di account business.

Come approfondito in questo articolo, il ruolo dell’orientatore contemporaneo richiede competenze che vanno ben oltre la consulenza tradizionale, includendo anche la padronanza degli aspetti legali e tecnologici del proprio operato.

Le zone d’ombra che nessuno spiega agli orientatori: casi reali di non conformità invisibile

Esistono situazioni operative quotidiane in cui gli orientatori violano il GDPR senza nemmeno rendersene conto. Il primo caso riguarda l’uso di browser con funzionalità IA integrate. Chrome, per esempio, ha introdotto funzioni di assistenza alla scrittura basate su intelligenza artificiale direttamente nel browser. Un orientatore che utilizza Chrome con account Google personale per redigere piani di orientamento, modificare curriculum o scrivere progetti contenenti dati di utenti sta inconsapevolmente trasferendo quelle informazioni ai server di Google senza le necessarie garanzie contrattuali. La soluzione? Disattivare completamente le funzionalità IA nel browser (nelle impostazioni avanzate) o passare a un account Google Workspace business.

Il secondo caso riguarda la gestione della posta elettronica professionale. Molti orientatori utilizzano Gmail con account personale gratuito per comunicare con gli utenti, allegare curriculum, scambiare documenti sensibili. Anche in questo caso, senza un account business Google Workspace, stanno violando il GDPR perché non esiste un DPA tra il professionista e Google per il trattamento dei dati dei clienti. Questa situazione riguarda potenzialmente migliaia di operatori che non hanno mai considerato la propria casella email come un punto critico di conformità normativa.

Il terzo caso, particolarmente insidioso, riguarda i liberi professionisti dell’orientamento. La maggior parte delle piattaforme IA offre account business solo per team o organizzazioni, richiedendo un numero minimo di licenze. ChatGPT Team, per esempio, parte da due utenti. Questo significa che un consulente di carriera che lavora in autonomia non può accedere a un account conforme al GDPR per alcune delle piattaforme più potenti disponibili sul mercato. Al momento della stesura di questo articolo, le uniche opzioni business disponibili per singoli professionisti sono Google Workspace Individual e Microsoft 365 Business. Questo gap normativo-commerciale costringe molti orientatori indipendenti a scegliere tra rinunciare a strumenti potenti o operare ai margini della legalità.

Ma esistono anche situazioni in cui la conformità è più sfumata. Se un orientatore utilizza l’IA esclusivamente per compiti che non coinvolgono dati personali degli utenti – per esempio, per generare esempi di curriculum fittizi per workshop formativi, per creare contenuti divulgativi sull’orientamento, per preparare materiali didattici generici – non sta violando alcuna norma privacy, anche con account personali. La discriminante è sempre: sto trattando dati che riguardano persone reali identificabili?

Strategie operative per orientatori: come sfruttare l’IA rimanendo nella legalità

Di fronte a questo quadro complesso, quali sono le opzioni concrete per un orientatore che vuole integrare l’intelligenza artificiale nel proprio lavoro senza violare il GDPR? La prima strategia, quella più robusta ma anche più costosa, è investire in account business conformi. Per organizzazioni, centri di orientamento, agenzie formative o enti pubblici la scelta è obbligata: attivare licenze ChatGPT Team/Enterprise, Microsoft 365 Copilot for Business o Google Workspace con Gemini, assicurandosi che il contratto includa un Data Processing Agreement conforme all’articolo 28 del GDPR, data residency nell’Unione Europea e garanzie sul non utilizzo dei dati per training dei modelli.

Questa soluzione comporta costi significativi – si parla di decine di euro per utente al mese – ma elimina completamente i rischi legali e permette di lavorare in modo fluido ed efficiente. Prima di attivare qualsiasi servizio, l’orientatore dovrebbe verificare meticolosamente: il contratto include esplicitamente un DPA? I dati vengono processati e conservati su server UE? Esiste un’opzione per impedire l’uso dei dati per training? Il fornitore offre garanzie di sicurezza certificate?

La seconda strategia è quella del “workflow ibrido locale-cloud”, adatta soprattutto ai liberi professionisti che non possono accedere agli account business. Questo approccio richiede competenza tecnica ma garantisce conformità assoluta. Il processo si articola in tre fasi: prima, l’orientatore utilizza un modello di IA che opera esclusivamente in locale sul proprio computer (GPT4All, Ollama, PrivateGPT) per anonimizzare totalmente un documento, sostituendo ogni elemento identificativo con codici alfanumerici e creando una tabella di corrispondenza che rimane solo sul dispositivo locale. Seconda fase: il testo completamente anonimizzato viene caricato su piattaforme cloud (ChatGPT, Claude, Copilot) per elaborazioni sofisticate che i modelli locali non riescono a gestire efficacemente. Terza fase: il testo elaborato viene scaricato e, utilizzando nuovamente l’IA locale, vengono ripristinati i dati originali attraverso la tabella di corrispondenza.

Come discusso in questo approfondimento, l’evoluzione della professione di orientatore richiede l’adozione di metodologie sempre più sofisticate che bilanciano innovazione tecnologica e responsabilità professionale.

La terza strategia, particolarmente efficace per consulenti di carriera e coach, è quella della “formazione guidata”: invece di elaborare direttamente i documenti degli utenti, l’orientatore insegna al cliente come utilizzare l’IA con il proprio account personale. Durante le sessioni, il cliente accede alla propria piattaforma (ChatGPT, Claude, etc.) e l’orientatore fornisce istruzioni vocali su come formulare prompt, come strutturare richieste, come valutare e raffinare i risultati. Questo approccio elimina completamente il rischio GDPR per l’orientatore (i dati non passano mai attraverso i suoi sistemi), trasforma il servizio da “esecutivo” a “formativo” con un upgrade di valore percepito, e fornisce al cliente competenze riutilizzabili autonomamente.

Questa terza via richiede però che l’utente abbia un minimo di alfabetizzazione digitale e disponibilità a essere attivamente coinvolto nel processo. Non funziona con tutti i target, ma rappresenta un’evoluzione interessante del modello di consulenza che risponde sia a esigenze normative sia a obiettivi di empowerment dell’utente.

Cosa succede quando si sbaglia: conseguenze reali della non conformità

La tentazione di sottovalutare le normative privacy è forte, soprattutto in un settore come l’orientamento dove la percezione del rischio è tradizionalmente bassa. “Chi vuoi che controlli un piccolo centro di orientamento?” è una frase che si sente spesso. Ma la realtà è cambiata radicalmente negli ultimi anni. Il Garante per la Protezione dei Dati Personali ha intensificato i controlli proprio sui professionisti e sulle piccole organizzazioni, consapevole che rappresentano l’anello debole della catena di conformità. E le sanzioni non sono teoriche: esistono casi documentati di multe a consulenti, formatori e operatori sociali per violazioni che coinvolgevano proprio l’uso improprio di strumenti digitali per il trattamento di dati personali.

Le conseguenze di una violazione GDPR si articolano su tre livelli. Il primo è quello sanzionatorio amministrativo: multe che per le infrazioni più gravi possono raggiungere 20 milioni di euro o il 4% del fatturato annuo globale, con un minimo comunque significativo anche per piccole realtà. Il secondo livello è quello della responsabilità civile: se un utente subisce un danno a causa del trattamento illecito dei propri dati, può richiedere un risarcimento che l’orientatore o l’ente dovrà pagare di tasca propria. Il terzo livello, spesso il più devastante, è quello reputazionale: in un settore basato sulla fiducia come l’orientamento, la notizia di una violazione privacy può distruggere anni di costruzione professionale.

Ma esiste anche un livello deontologico che va oltre le sanzioni formali. Gli orientatori sono professionisti che gestiscono momenti delicati della vita delle persone: transizioni di carriera, crisi occupazionali, scelte formative cruciali. La fiducia è il fondamento della relazione. Scoprire che i propri dati sono stati trattati in modo non conforme mina questa fiducia in modo irreparabile. E in un’epoca in cui la consapevolezza sui temi della privacy è in costante crescita, gli utenti sono sempre più informati e sempre più propensi a verificare come vengono gestite le loro informazioni personali.

Conclusione

La conformità al GDPR nell’uso dell’intelligenza artificiale per l’orientamento non è una questione burocratica o una complicazione tecnica evitabile. È una responsabilità professionale fondamentale che distingue orientatori consapevoli e preparati da operatori che navigano a vista in una zona di rischio legale e reputazionale. Le soluzioni esistono e sono accessibili: account business con Data Processing Agreement per organizzazioni e team, workflow ibridi locale-cloud per liberi professionisti, modelli di formazione guidata per consulenti individuali.

L’anonimizzazione leggera – quella che consiste nel cancellare nome e cognome – non basta e non basterà mai. La pseudonimizzazione reversibile non risolve gli obblighi normativi. Solo l’anonimizzazione totale e irreversibile, oppure l’uso di strumenti con garanzie contrattuali conformi al GDPR, permettono di sfruttare le potenzialità dell’IA rimanendo nella piena legalità.

Gli orientatori devono comprendere che ogni volta che caricano informazioni su un utente su una piattaforma di intelligenza artificiale stanno assumendo responsabilità precise. Non possono delegare questa consapevolezza al “non lo sapevo” o al “tutti fanno così”. La normativa europea sulla protezione dei dati non è un optional burocratico ma il framework che garantisce dignità e tutela alle persone nei processi digitali. E gli orientatori, che accompagnano le persone nelle scelte più importanti della loro vita professionale, hanno il dovere di essere i primi a rispettare questa dignità.

Scopri come Jobiri può aiutarti a migliorare, innovare e ottimizzare la tua pratica di orientamento: contattaci qui.

CEO e co-fondatore di Jobiri, impresa innovativa che utilizza l’AI per facilitare l’inserimento lavorativo. Con oltre 15 anni di esperienza in management e leadership, Claudio è un esperto nella gestione aziendale e nelle tematiche di sviluppo organizzativo. La sua visione strategica e il suo impegno sociale fanno di lui un punto di riferimento nel settore.